最近は「新しいBing」やPerplexity AIみたいに、出典を示しつつ質問に答えてくれるAIサービスが出てきて調べ物がはかどります。

「出典がある」ということは、必ずしも「その情報は信頼に足る」ということではなくて、「その情報が信頼に足るものかどうかを判断する足がかりがある」ということです。場合によっては、その判断がむずかしかったりします(>_<)

そんな中、質問に関係しそうな論文を返してくれるConsensusというサービスがあることを知りました。あ、これ便利ー。

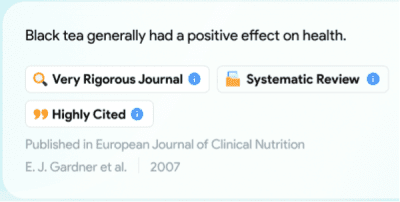

論文を検索するだけならGoogle Scholarというサービスがあったけど、Consensusのいいところは、論文ごとに「どのぐらい信頼に足るか」に関係する情報のラベルをつけてくれるということ。

たとえば「システマティックレビュー」というスタイルの論文は、科学論文の中で一番証拠として強いものと一般に見なされているけれど、

そういう情報が結果からひと目でわかります。

上の例だと、「紅茶が体にいい」という論文は、システマティックレビューだというだけでなく、めっちゃ審査の厳しい学術誌(Very Rigorous Journal)に載ってて、ほかの論文からいっぱい引用されてる(Highly Cited)ということもわかります。

(引用数についてはGoogle Scholarでもわかるけれど。)

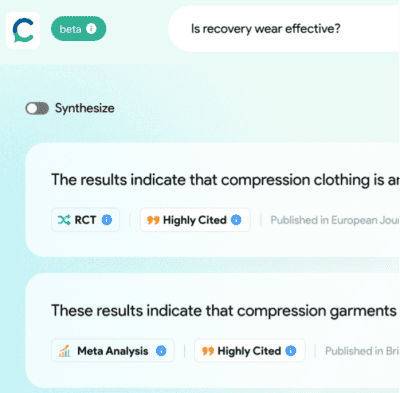

2014年に、リカバリーウェアってほんまに効き目あるんかなと思って、当時ネットで調べてもいい話しか出てこなかったんですが、これ調べてみよう。

へー、コンプレッションウェアは回復に効き目があるっていう論文があるんや。“Meta Analysis"はシステマティックレビューの一種で、“RCT”(ランダム化比較試験)はシステマティックレビューの次に強い証拠とされています。

でもプラチナを織り込んだウェアの話じゃないみたい。

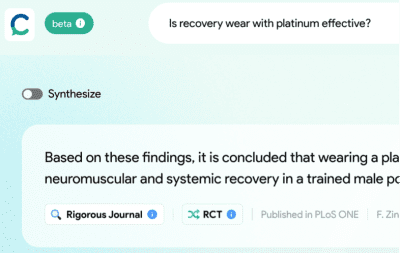

じゃあ、「プラチナ入り」を質問に入れてみよう。

すると「効き目がなかった」というRCTな論文がヒット。“Very"ではないけれど審査の厳しい学術誌(Rigorous Journal)に載ったもののようです。

中を読むと、あのメーカー名がずばり出ています。なるほど、そっかー。

まちがいだとわかった論文はどう表示されるかなど、もう少しいろいろ試してみました。

Custom GPT統合されて日本語にも対応したので、こちらも試してみました。

コメント