1月にこのブログをSSL化して、Googleのインデックス(検索結果に含めるページ一覧みたいなもの?)をまるごと新URLにするためにGoogle Search Consoleを使い始めていましたが、先日ようやく旧URLをインデックスから根絶させました。

まだやることは残っているんですが、この8か月ほどの試行錯誤で見えてきたあれこれをメモしておきます。長いですが、SEOの話ではないです。

アドレス変換ツールはあまりあてにならない

旧URLと新URLを両方Google Search Consoleの管理対象に追加した状態で、「新URLは旧URLからの移行先だ」とGoogleに知らせるのがアドレス変換ツールの役割みたいなんですが、これが期待通りに動いてくれません。

この設定をしていても、旧URLでインデックスへの新規登録がされてしまうこともあるし、しかも旧の方と内容が重複しているとして新URL側がインデックス登録できなくなってしまうことも。

ただ待っていても、旧URLのインデックスを新URLに一括変換してくれたりはしないようなので、新URL側のインデックス登録は地道に手作業でやっていくことにしました。

インデックス管理用スプレッドシートを作成する

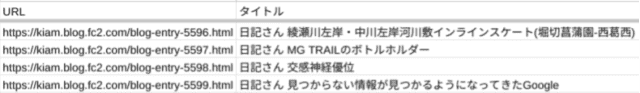

どのページがインデックスに登録されてて、どのページを登録リクエストしたかとかを管理するために、

まずこんな感じのスプレッドシートをせっせと作りました。5000数百行。

ページタイトルはURLから関数を使っても取れるんですが、行数が多すぎるとまったく動かなくなるので、

このツールで一括取得してコピペしました。

あとは別シートにインデックス登録済みページ一覧を作って、XLOOKUPでマッチングさせたり。

インデックス登録済みページは、Google Search Console上「前回のクロール」日の最新1000件しか表示されないので、完全には管理しきれなかったりするんですが、そういうのの対応含めこのスプレッドシートのこまごました工夫は割愛します。

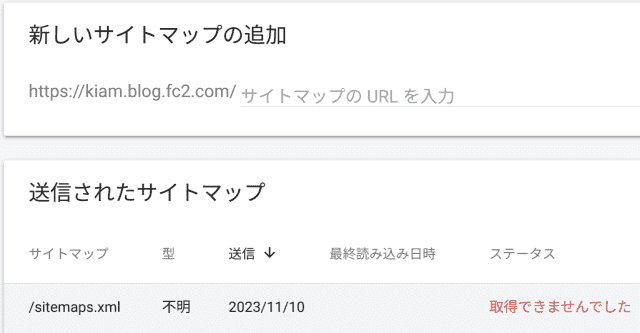

FC2ブログのサイトマップの謎

インデックスは手作業で登録しなくても、サイトマップさえあれば勝手に巡回してくれるんじゃない?とも思ったんですが、

FC2ブログの自動生成するサイトマップをGoogle Search Consoleが読み込んでくれません。

FC2ブログのサイトマップはHTTPSに対応していないという話がGoogleのフォーラムにあったので、FC2のユーザーサポートに問い合わせをしてみたんですが、そんなことはないとの回答。

urlset xmlns=“ http://www.sitemaps.org/schemas/sitemap/0.9"

サイトマップの1行目にこんな部分があって、HTTPSドキュメントの中にHTTPな部分が混在しているのがよくないのでは?と思って聞いてみたんですが、

Googleのドキュメントで"http"と書くよう指定されているのでこれで正しいとの回答。

FC2サーバのログからすると、そもそもサイトマップのファイルをGoogleから読みに来ていないとのことなので、Googleに問い合わせてほしいとのことでした。

そんな窓口Googleにないので、サイトマップに関してはここであきらめました。

(フォーラムはあるけど、同じ症状の問い合わせが解決してないし。)

ブログのドメインを

○○○.blog.fc2.com

↓

△△△.fc2.net

のように変えると、Google Search Consoleでサイトマップが読み込めるようになりました。

手動でのインデックス登録リクエスト

Google Search Consoleでは、入力したブログの個別ページのURLを検査して、そこからインデックス登録のリクエストをすることができます。

(このリクエストをすると、すぐにクローラが巡回してきて、だいたいその日のうちにはインデックス登録される印象です。)

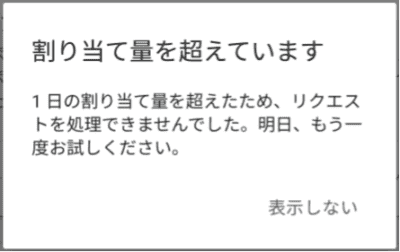

このリクエストが、一気にたくさんはできないようになっています。

どういう形で制限がかかっているかというと、これがちょっと複雑。厳密に解明できたわけではなくて、若干もやっとしたところの残る経験則です。

基本枠は1日11ページ。10でなくなぜか11。

朝0時になったら11枠まるごと復活するとかでなく、それぞれの枠が消費されてから24時間後にそれぞれ復活している模様。

連続でリクエストすると、12ページ目でこういうエラーが出るんですが、実はこれ1分待つと1つだけ枠が空きます。これは基本の11枠とは独立した別枠。

(この追加枠は、なぜかまったく発生しない日があったりします。)

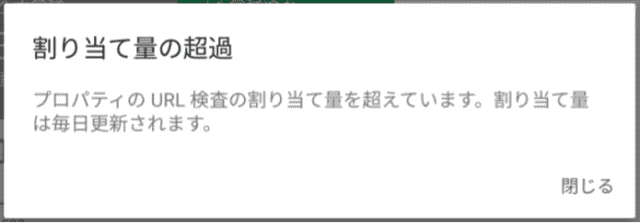

つまり、1分空けさえすれば繰り返しリクエストし続けることができるんです。でもこれも無限にできるわけではありません。

リクエストの手前のURL検査のところに回数制限があって、これが1日で101回。100でなくなぜか101。

このURL検査枠は、その日の1枠目消費の24時間後に101枠が一気に回復するイメージです。

(ゆっくりやった日の翌日にすばやくやっても、同じ数で頭打ちになります。)

インデックスの自動登録と自動削除

「追加枠」のことを最初は気づいていなかったので、朝のルーティンとして1日11ページずつちまちまとリクエストをしていたんですが、

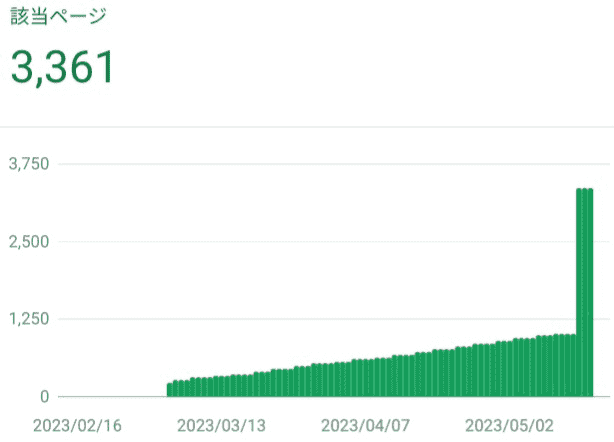

日々のリクエストとは関係なく、ある日猛烈な勢いでクローラが巡ってきて、一気に1500ページほどインデックス登録されたタイミングがありました。

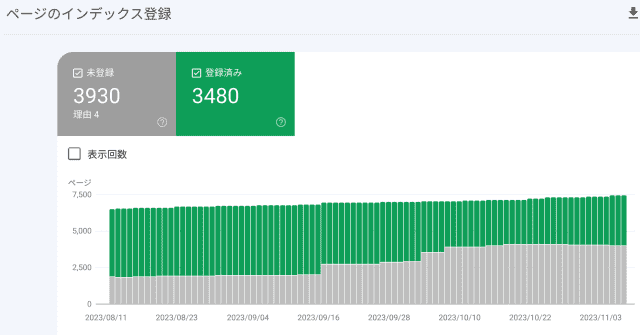

その逆に、インデックス登録済みのページが「クロール済み - インデックス未登録」に格下げされることもありました。灰色ゾーンがぐっと広がって緑を侵食しているところ。

この場合、一度灰色化した元緑ページも再リクエストで緑に戻ります。

でもこの灰色化の条件がよくわかりません。ほかのサイトに情報がなくてアクセスがそれなりにあったお役立ち系ページも灰色になることがあったりして、ニーズがないとそうなるという感じでもないです。

あと、最近気がついたんですが、「前回のクロール」日が6か月前以前になったものは、「ページはインデックスに登録されていません: URL が Google に認識されていません」の状態、つまり一度もクロールされたことない扱いに戻されています。さっきのグラフだと、緑でも灰色でもない「無」です。

インデックスにごみの発生しないrobots.txt(FC2ブログ用)

たとえば今日の日記のURLは

https://kiam.blog.fc2.com/blog-entry-5600.html

ですが、

https://kiam.blog.fc2.com/blog-date-20231110.html

という日付URLでも見られます。

日付URLだと、タイトルが記事名でなく日付になってしまうので、検索結果に並ぶと中身がわかりにくいです。

なので、インデックスには日付URLは含めたくない。

あと、スマホ版ページのURLには"?sp"がついたり、同じ内容のものにいろんなバージョンが存在するとややこしそうなので、

blog-entry-*.html

という素のファイル名以外はインデックス登録しないようにもしたいです。

そういうようなわけで、FC2ブログ標準のrobots.txtに

Disallow: /blog-date-*

Disallow: /blog-category-*

Disallow: /?*

Disallow: /?

今はこの4行を追加して使っています。

コメント